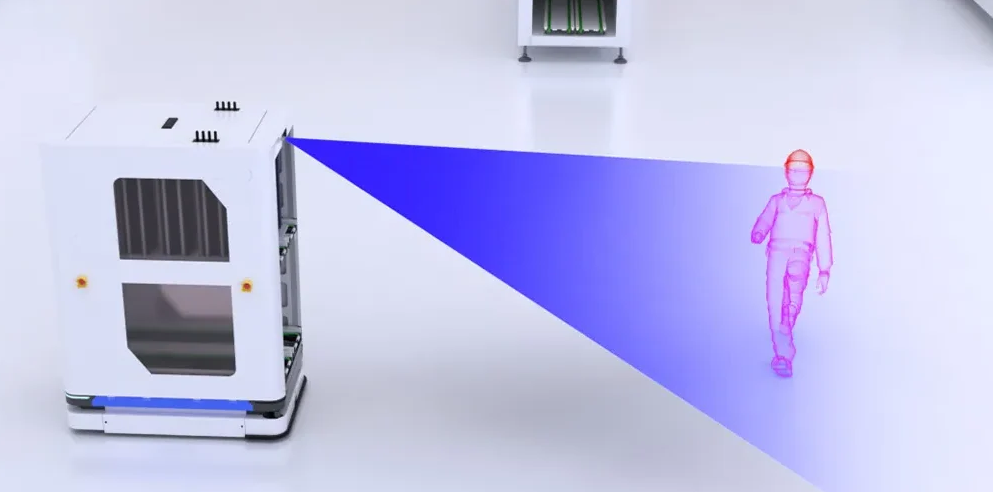

La detección de obstáculos 3D es un sistema avanzado diseñado para mejorar la seguridad, el rendimiento operativo y la autonomía de robots móviles en entornos dinámicos.

A diferencia de soluciones basadas únicamente en sensores 2D (como LiDAR plano), la percepción 3D mediante cámaras RGB-D o sensores ToF permite identificar alturas, volúmenes, profundidades y estructuras reales del entorno, distinguiendo obstáculos permanentes, temporales, estáticos o en movimiento.

El sistema genera un mapa espacial tridimensional en tiempo real, detecta obstáculos y permite al robot planificar rutas seguras sin interrupciones, reduciendo significativamente riesgos, colisiones y tiempos muertos.

Objetivos del sistema de detección de obstáculos 3D

El sistema está diseñado para:

- Detectar objetos y obstáculos en 3D dentro del entorno inmediato del robot.

- Medir la profundidad real y la distancia exacta entre el robot y los elementos del entorno.

- Generar mapas espaciales 3D actualizados en tiempo real durante la navegación.

- Distinguir entre obstáculos estáticos y dinámicos, mejorando la toma de decisiones.

- Clasificar objetos mediante semántica visual, permitiendo respuestas inteligentes.

- Realizar planificación de rutas adaptativa, evitando colisiones y detenciones innecesarias.

- Integrarse fácilmente en robots móviles a través de interfaces estándar (I/O, Ethernet, API).

- Operar con robustez en entornos logísticos, industriales y sanitarios.

Arquitectura general del sistema de detección de obstáculos 3D

El sistema fusiona información visual, profundidad 3D, semántica de objetos y cinemática del robot para generar una percepción espacial completa.

Los componentes principales son:

Sensor de profundidad (ToF / RGB-D)

El sensor ToF es el corazón de la percepción 3D:

- Emite luz infrarroja y mide el tiempo de retorno.

- Captura un mapa de profundidad 3D en tiempo real.

- Permite detectar obstáculos a distintas alturas (suelo, medio, techo).

- Funciona incluso en entornos con iluminación variable.

Genera una nube de puntos densa para el algoritmo.

Cámara RGB para semántica visual

Aporta información de color y textura, esencial para:

- Identificación de objetos (personas, carros, pallets, estanterías…).

- Segmentación semántica del entorno.

- Distinción entre obstáculos temporales y permanentes.

- Priorización de rutas según tipo de objeto.

Unidad de medición inercial (IMU)

Aunque no es obligatoria para detectar obstáculos, mejora:

- La estabilidad durante el movimiento del robot.

- La alineación entre frames de profundidad.

- La compensación de vibraciones.

Núcleo de detección de obstáculos

El motor central del algoritmo ejecuta:

1. Generación de nube de puntos 3D

A partir del sensor ToF se obtiene un modelo tridimensional continuo.

2. Segmentación de obstáculos

- Detección de objetos en el volumen 3D

- Separación entre elementos del entorno

- Detección de bordes, huecos, desniveles

3. Reconocimiento semántico

El sistema identifica el tipo de objeto mediante redes neuronales:

- Persona

- Vehículo

- Pallet

- Caja

- Mueble

- Estructura fija

- Obstáculo temporal

Permite tomar decisiones más inteligentes.

4. Clasificación dinámica

Determina si el objeto:

- Está parado

- Se mueve

- Invade la trayectoria del robot

- Debe evitarse, rodearse o ignorarse

5. Planificación adaptativa de trayectoria

El robot ajusta en tiempo real:

- Velocidad

- Dirección

- Curvas

- Paradas seguras

- Desvíos inteligentes

6. Integración con el control del robot

A través de:

- Entradas/salidas (I/O)

- Ethernet o API

El sistema envía señales inmediatas para evitar colisiones.

Especificaciones del sistema de detección de obstáculos 3D

- Tecnología: ToF / RGB-D

- Rango de detección: según óptica (0,5–10 m típico)

- Precisión de profundidad: ±1–5 mm

- Actualización: 20–60 fps

- Campos de visión:

- Horizontal según modelo (60°–120° típico)

- Vertical según montaje

- Capacidad semántica:

- Detección de personas

- Obstáculos dinámicos

- Obstáculos fijos

- Interfaz de integración:

- I/O para señales de parada o evasión

- Ethernet / API para navegación avanzada

- Procesamiento: On-edge (sin PC externo)

- Robustez ambiental:

- Iluminación variable

- Polvo, reflejos, cambios temporales

Casos de uso típicos

- Robots móviles autónomos en almacenes y logística.

- AGVs / AMRs que deben evitar personas y objetos imprevistos.

- Carros autónomos en hospitales, donde abundan obstáculos temporales.

- Robots de picking automático con navegación colaborativa.

- Vehículos autónomos industriales que circulan en pasillos estrechos.

- Drones o plataformas móviles con necesidades de detección volumétrica.

- Sistemas donde se requiere distinguir alturas (por ejemplo, vigas, brazos robóticos, estanterías altas).